━━━━━━━━━━━━━━━━━━━━━━━━━━

JRRCマガジン No.422 2025/6/12

━━━━━━━━━━━━━━━━━━━━━━━━━━

※マガジンは読者登録の方と契約者、 関係者の方にお送りしています。

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

◆今回の内容

【1】井奈波先生の欧州AI規則の解説

━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━━

皆さま、こんにちは。いかがお過ごしでしょうか。

本日6月12日は「児童労働反対世界デー」

国際労働機関(ILO)が世界に蔓延する児童労働をなくそうと呼び掛けるために 制定されたそうです。

さて、今回は井奈波先生の「欧州AI規則の解説」 です。

井奈波先生の前回の連載は下記からご覧いただけます。

https://jrrc.or.jp/category/inaba/

━━ ◆◇◆【1】井奈波先生の 欧州AI規則の解説━━━

第2回 AI規則の適用範囲

━━━━━━━━━━ ━━━━━━━━━━━━━ ◆◇◆

今回は、AI規則の規制対象となるAIおよび名宛人について説明し、我が国においてAI規則がどのような影響を与えるかを考察します。なお、今回問題となる条文と前文との対応関係は、前回の連載を参照してください。

1 適用対象となるAI

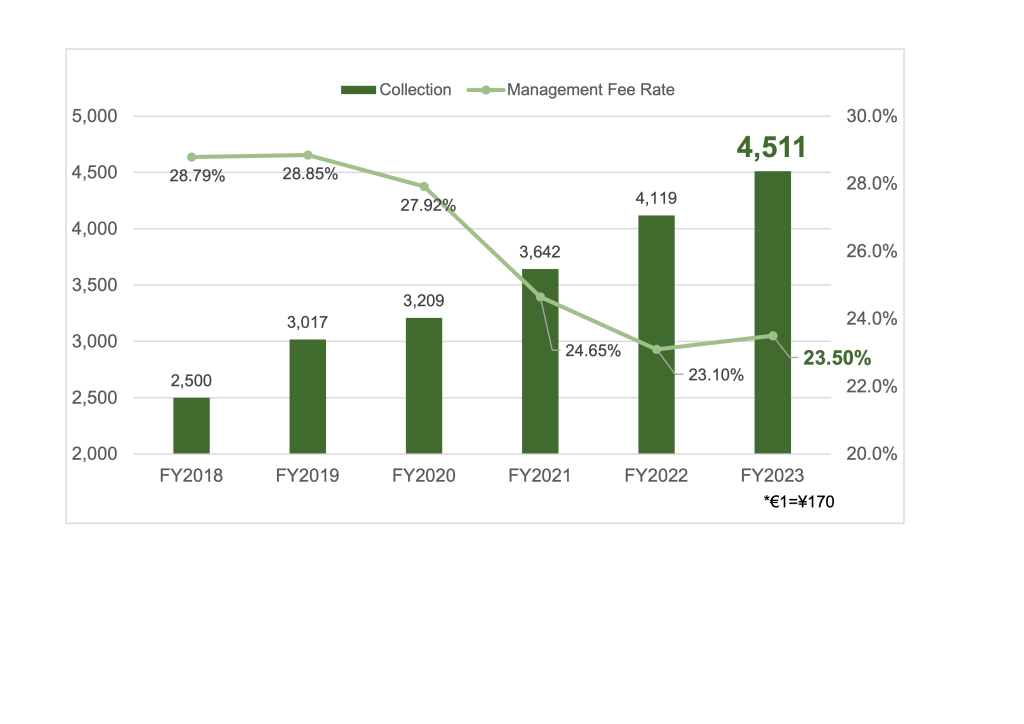

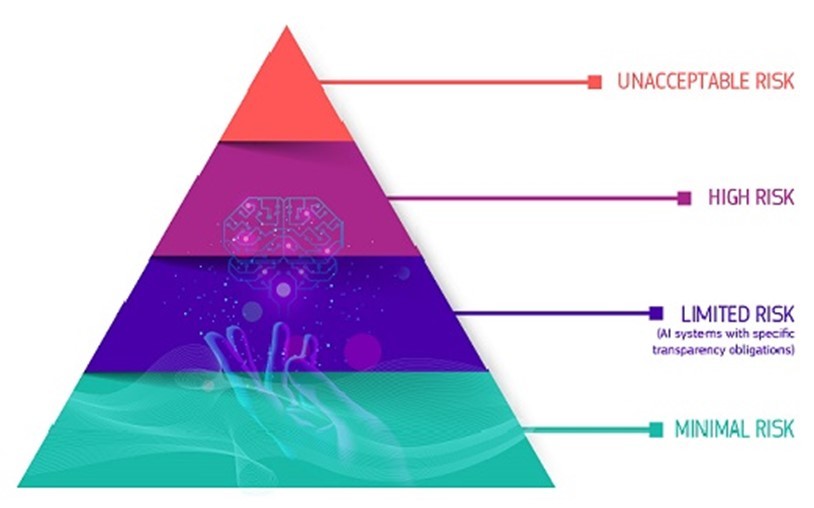

AI規則は、AIに対する規制についてリスクベースアプローチを採用しています(前文26項、27項)。リスクベースアプローチとは、AIシステムが惹起する可能性のあるリスクの大きさと範囲に合わせてルールを定めることで、リスクは4つのカテゴリーに分類されます(表2-1)。

この分類は、EU市場においてAIシステムを上市するにあたり、どのカテゴリーに該当し、したがって、どのような対応をとるべきかを判断するために重要となります。

表2-1 リスクベースアプローチを示すピラミッド

引用元:https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

(1) 容認できないリスクのあるAIシステム

容認できないリスクのあるAIは、表2-1の最上階に位置するもので、AI規則5条で禁止されます。基本的権利に対するリスクを含む、欧州の価値観からみて容認できないリスクをもたらすAIシステムが禁止の対象です。5条は、2025年2月2日から適用が開始され、ガイドラインが公表されています。

https://digital-strategy.ec.europa.eu/en/library/commission-publishes-guidelines-prohibited-artificial-intelligence-ai-practices-defined-ai-act

(2) ハイリスクAIシステム

表2-1の上から2番目に位置するものであり、健康、安全および基本的権利に高度なリスクをもたらすAIシステムがこれに該当します。何がハイリスクAIシステムに該当するのかについては、商品に関係するAIシステムは6条1項と附属書Ⅰ、

サービスに関するAIシステムは 6条2項と付属書Ⅲにそれぞれ定められています。これらのシステムには、AI規則第Ⅲ章に定める所定の義務が課されます。

(3) 限定的なリスクを有するAIシステム

表2-1の下から二番目に位置し、4つのカテゴリー、つまり①チャットボット、②合成コンテンツ生成AI、③感情認識システムと生体分類システム、④ディープフェイクに分類され、透明性義務を負います(50条)。

(4) ミニマルリスクのAIシステム

表の底辺部分に分類されるものであり、リスクが最小限であるため、AI規則においては直接的に規制されていませんが、提供者と導入者は自発的に行動規範を遵守することが推奨されます(95条)。たとえば、スパムフィルター、AI対応のビデオゲームなどがこれに該当するとされます。

AIシステムの定義ガイドライン(https://digital-strategy.ec.europa.eu/fr/library/commission-publishes-guidelines-ai-system-definition-facilitate-first-ai-acts-rules-application)によれば、AIシステムの大多数はこのカテゴリーに分類されるといわれています(63項)。

そうであれば、AI規則が与える影響は限定的であり、(1)~(3)に限定列挙されているAIシステムについて留意すればよいといえます。

(5) 汎用AIモデル(リスクベースアプローチに基づかない規制)

リスクベースアプローチは、禁止される所定のAIシステムや商品・サービスと結びついた所定のハイリスクAIシステムなど、AIシステムの用法に着目してリスクを分類し、ひいては規制されるAIシステムを分類しています。しかし、近年のAI技術の進展により、用法の特定ができず、

上記のリスクベースアプローチに収まらない汎用AIについて考慮する必要性が生じました。このカテゴリーにおいては、システミックリスクを示すかどうかによって汎用モデルを分類し、規制します(第Ⅴ章)。

システミックリスクを示すかどうかは、 AIモデルの性能により判断されます(3条、51条)。

2 AI規則が適用される者

AI規則が適用される者は、EU域内の提供者、導入者、輸入者、頒布者、製品メーカー、代理人および関係者(2条1項)であり、これらの者は、関係者を除き、まとめてオペレータといわれます(3条8号)。

このほか、EU域外の一定の者についても、公正競争を保証し、EU市民の権利および自由を効果的に保護するため(前文21項)、AI規則が直接的に適用されるます(表 2ー2)。

(1) 提供者( provider)。

提供者は、域内においてAIシステムまたは汎用AIモデルを開発しまたは開発させ、自己の名または商標で、有償または無償で、それらを上市しまたはサービスを開始する者です(3条3号)。提供者は、EU域外の者もAI規則の適用対象となります(2条1項a)。

自然人・法人を問わず対象となり、公的機関も対象となります。

したがって、EU市場をターゲットとする我が国の自然人・法人は AI規則の適用対象となり得ます。

加えて、AIシステムにより生じる出力がEU域内において使用される場合のAIシステムの提供者は、第三国に所在する者も適用対象となります(2条1項c)。

(2) 導入者( deployer)。

AIシステムの導入者が適用対象となりますが、域内において設立または所在する者に限られます。導入者とは、AIシステムを使用する者を指します(3条4号)。ハイリスクAIシステムの導入者にも一定の義務が課されます(26条以下)。

加えて、AIシステムにより生じる出力がEU域内において使用される場合のAIシステムの導入者は、第三国に所在する者も適用対象となります(2条1項c)。

(3) AIシステムの輸入者(importer)およびAIシステムの頒布者(distributor)(2条1項c、3条6号、7号)。

(4) 製品メーカー( product manufacturer)。

その名または商標で、製品とともにAIシステムを上市しまたはサービスを開始する製品メーカーがAI規則の適用対象となります(2条1項e)。製品メーカーについては域内との限定がなく、我が国の製品メーカーも適用対象となり得ます。

(5) 域内に設立されていない提供者の代理人( authorised representative of providers)

第三国において設立された提供者は、ハイリスクAIシステムをEU市場に利用に供する前に、代理人選任義務を負い(22条)、

その場合の代理人が適用対象となります。代理人は、EU域内に所在しまたは設立された自然人または法人である必要があります(3条5号)。なお、仏語にはauthorisedに相当する単語はないので、単に代理人と訳出しています。

(6) 関係者( affected persons)。

関係者の定義はありませんが、AIによって影響を受ける域内のすべての者を意味すると考えられます(前文171項)。

表2-2 AI規則が適用される主体

対象者 ()内は2条1項の号に対応 適用範囲(日本が影響を受ける場合)

域内においてAIシステムを上市またはサービスを開始する提供者。汎用AIモデルを上市する提供者(a)。 域内外問わず適用

AIシステムにより生じる出力が域内において使用される提供者(c) 域内外問わず適用

域内で設立されまたは域内に所在する導入者(b)

AIシステムにより生じる出力が域内において使用される導入者(c) 域内外問わず適用

AIシステムの輸入者(d)

AIシステムの頒布者(d)

製品とともにAIシステムを上市またはサービスを開始する製品メーカー(e) 域内外問わず適用

域外の提供者の代理人(f)

域内の関係者(g)

3 適用除外

AI規則は、その適用外となる領域についても、以下のとおり、規定しています(2条、表2-3参照)。

(1) 軍事目的、防衛目的、国家安全保障目的のみで上市、サービス開始または仕様されるAIシステム(2条3項)。

「のみ」でなく、民生目的と併用される場合は、AI規則の適用があります(前文24項)。

(2) 法執行協力および司法協力のための国際協力の枠組みで加盟国が第三国の公的機関と協力してAIシステムを使用する場合の当該第三国の公的機関(2条4項)。

ただし、当該第三国が、基本的権利と自由の保護に関して適切なセーフガードを提供していることが条件となります。したがって、問題はないかと思いますが、我が国の人権保障のレベルが問題となり得ます。

(3) 学術的な研究開発目的で開発される AIシステムまたはAIモデル(2条6項)

これはイノベーションを支援する目的による適用除外です。

(4) 上市またはサービス開始前の AIシステムまたはAIモデルに関する研究開発(2条8項)。

AI規則が、マーケットベースアプローチを採用したことによる適用除外です。

(5) 自然人による事業性のない個人的な AI使用(2条10項)。

たとえば、自然人の犯罪行為は「個人的」とはいえないので、これには含まれません(禁止されるAIのガイドライン34項)。

(6) フリーでオープンソースのライセンスに基づきリリースされた AIシステム(2条12項)。

ただし、禁止されるAIシステム、ハイリスクAIシステム、一定のAIシステム(50条)として上市またはサービスが開始される場合は適用除外となりません。

表2-3 適用除外のまとめ

軍事目的、防衛目的、国家安全保障目的のみで上市、サービス開始または仕様されるAIシステム 2条3項

法執行協力および司法協力のための国際協力の枠組みで加盟国が第三国の公的機関と協力してAIシステムを使用する場合の当該第三国の公的機関 2条4項

学術的な研究開発目的で開発されるAIシステムまたはAIモデル 2条6項

上市またはサービス開始前のAIシステムまたはAIモデルに関する研究開発 2条8項

事業性のない個人的な自然人のAI使用 2条10項

フリーでオープンソースのAI 2条12項

━━━━━━━━━━━━━━━━━◆◇◆

インフォメーション

━━━━━━━━━━━━━━━━━━━━

JRRCマガジンはどなたでも読者登録できます。 お知り合いの方などに是非ご紹介下さい。

□読者登録、 配信停止等の各種お手続きはご自身で対応いただけます。

ご感想などは下記よりご連絡ください。

⇒https://jrrc.or.jp/mailmagazine/

■各種お手続きについて

JRRCとの利用契約をご希望の方は、 HP よりお申込みください 。

(見積書の作成も可能です )

⇒https://jrrc.or.jp/

ご契約窓口担当者の変更

⇒https://duck.jrrc.or.jp/

バックナンバー

⇒https://jrrc.or.jp/mailmagazine/

━━━━━━━━━━━━━━━━━◆◇◆

お問い合わせ窓口

━━━━━━━━━━━━━━━━━━━━

公益社団法人日本複製権センター (JRRC)

⇒https://jrrc.or.jp/contact/

※このメルマガはプロポーショナルフォント等で表示すると改行の 位置が不揃いになりますのでご了承ください。

※このメルマガにお心当たりがない場合は、お手数ですが、 上記各種お手続きのご意見・ご要望よりご連絡ください。